LM Studio

AIローカルLLMローカルPC上で大規模言語モデル(LLM)を実行できるデスクトップアプリ。Llama、Mistral等のオープンソースモデルをGUI操作で簡単にダウンロード・実行。

LM Studioとは?

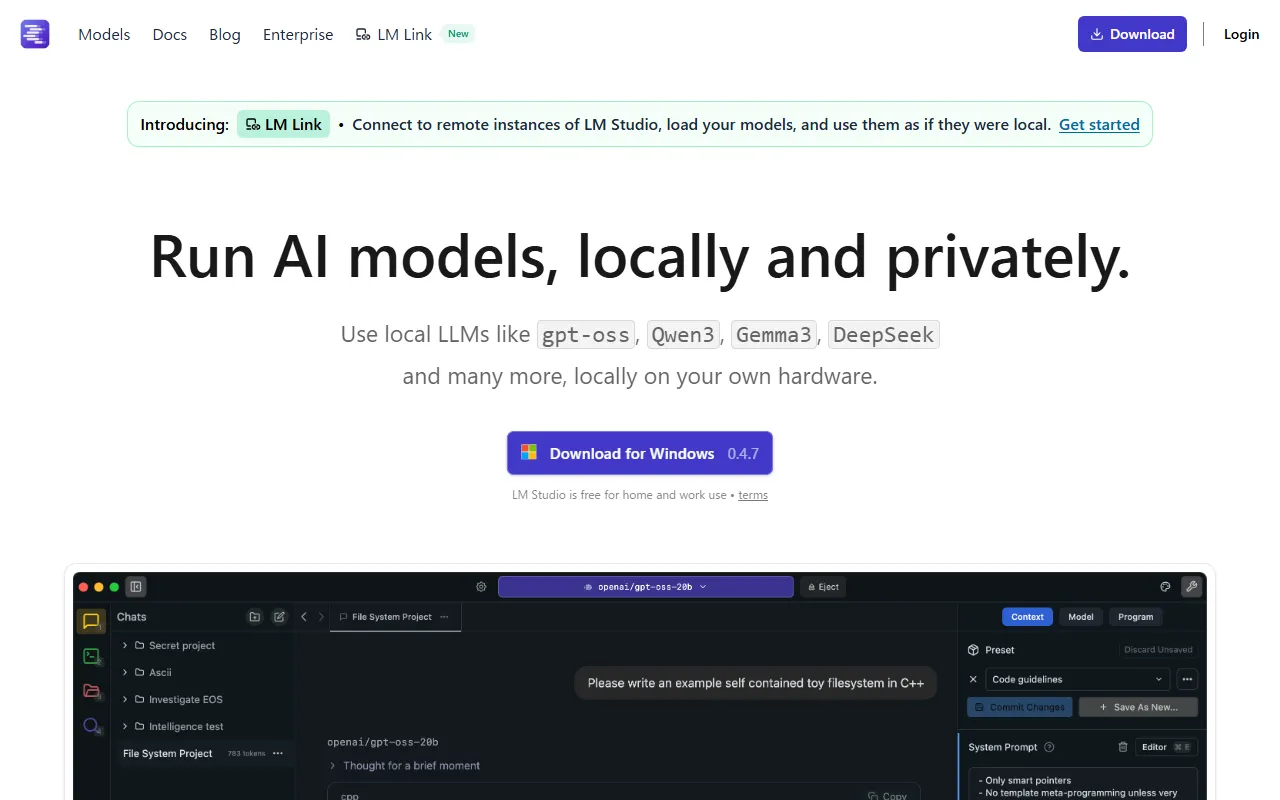

LM Studioは、大規模言語モデル(LLM)をローカルPC上で実行するためのデスクトップアプリケーションです。Llama 3、Mistral、Phi、Gemma、Qwen等の主要なオープンソースモデルを、プログラミング不要のGUI操作でダウンロード・実行できます。インターネット接続なしで完全にオフラインでAIを利用でき、データが外部に送信されないためプライバシーが完全に保たれます。 Hugging Face上の数千のモデルをアプリ内から直接検索・ダウンロードでき、GGUF形式の量子化モデルに対応してメモリ効率の良い推論が可能。ChatGPT互換のローカルAPIサーバー機能も内蔵しており、既存のアプリケーションやスクリプトからローカルLLMを呼び出すことも可能です。2026年現在、マルチモーダルモデル対応、RAG(検索拡張生成)機能、モデルの比較機能も追加。GPU不要でCPUのみでの動作も可能で、M1以降のMacでは特に高速に動作します。

料金プラン

主な機能・特徴

メリット・デメリット

メリット

- ●完全無料でオープンソースLLMをローカル実行

- ●インターネット不要でプライバシーが完全に保護

- ●GUIで直感的にモデルをダウンロード・管理

- ●ChatGPT互換APIサーバー機能を内蔵

デメリット

- ●高性能なモデルにはGPU搭載PCが推奨される

- ●クラウドAI(GPT-4o、Claude等)に比べると回答品質は劣る

- ●モデルファイルが大きく(数GB〜数十GB)ストレージを消費する

よくある質問(FAQ)

Q. LM Studioは本当に無料ですか?

A. はい、LM Studio自体は完全無料で利用できます。実行するオープンソースモデルも無料でダウンロード可能です。クラウドへのデータ送信も一切なく、追加料金は発生しません。

Q. どのくらいのPCスペックが必要ですか?

A. 最小要件はRAM 8GB以上ですが、16GB以上を推奨します。GPUなしでも動作しますが、GPUがあると大幅に高速化されます。Apple Silicon(M1以降)のMacでは特に効率的に動作します。7B〜13Bパラメータのモデルであれば16GBのRAMで実用的に利用可能です。

Q. ChatGPTの代わりになりますか?

A. 日常的な質問や文章作成であれば十分代替可能です。ただし、GPT-4oやClaude 4レベルの最先端モデルに比べると回答品質は劣ります。プライバシーを最優先する場合や、インターネット接続なしで使いたい場合に最適な選択肢です。

関連比較記事

LM Studio vs Ollama 徹底比較!どっちがおすすめ?【2026年最新】

ローカルLLM実行環境LM StudioとOllamaをUI・対応モデル・パフォーマンス・拡張性で徹底比較。あなたに最適なローカルAI環境を選びましょう。

Ollama vs LM Studio 徹底比較!ローカルLLM実行ツール【2026年最新】

ローカルLLM実行環境のOllamaとLM Studioを対応モデル・使いやすさ・API互換性・パフォーマンスで徹底比較。プライバシー重視のAI活用を解説。

Ollama vs LM Studio 徹底比較!ローカルLLMツール対決【2026年最新】

OllamaとLM Studioを操作性・対応モデル・パフォーマンス・API機能で徹底比較。最適なローカルLLM実行環境を見つけましょう。

関連するAI用語

関連ブログ記事

関連ツール

Ollama

ローカルPCでLLMを実行するオープンソースツール。プライバシーを完全に保護。

Open WebUI

Open WebUI(オープンウェブUI)は、OllamaやOpenAI互換APIに対応した無料・オープンソースのセルフホスト型AIチャットUI。ローカル環境でChatGPTライクなUIを実現。

AnythingLLM

ローカルで動作するオールインワンAIデスクトップアプリ。RAG(検索拡張生成)、マルチLLM対応、ドキュメント管理を統合し、プライバシーを保ちながらAIを活用可能。

Jan

オープンソースのローカルAIチャットアプリ。GPT-4o・Claudeのクラウド接続に加え、Llama・Mistral等のローカルLLMをGUIで簡単に実行。プライバシー重視設計。

GPT4All

インターネット不要でローカルPCで動作するオープンソースAIチャットボット。プライバシーを完全に保護しながら、無料でLLMを利用可能。

ComfyUI

ノードベースのUI(視覚的フロー)でStable Diffusionを操作する画像生成ツール。ワークフローの自由なカスタマイズにより、高度な画像生成パイプラインを構築可能。