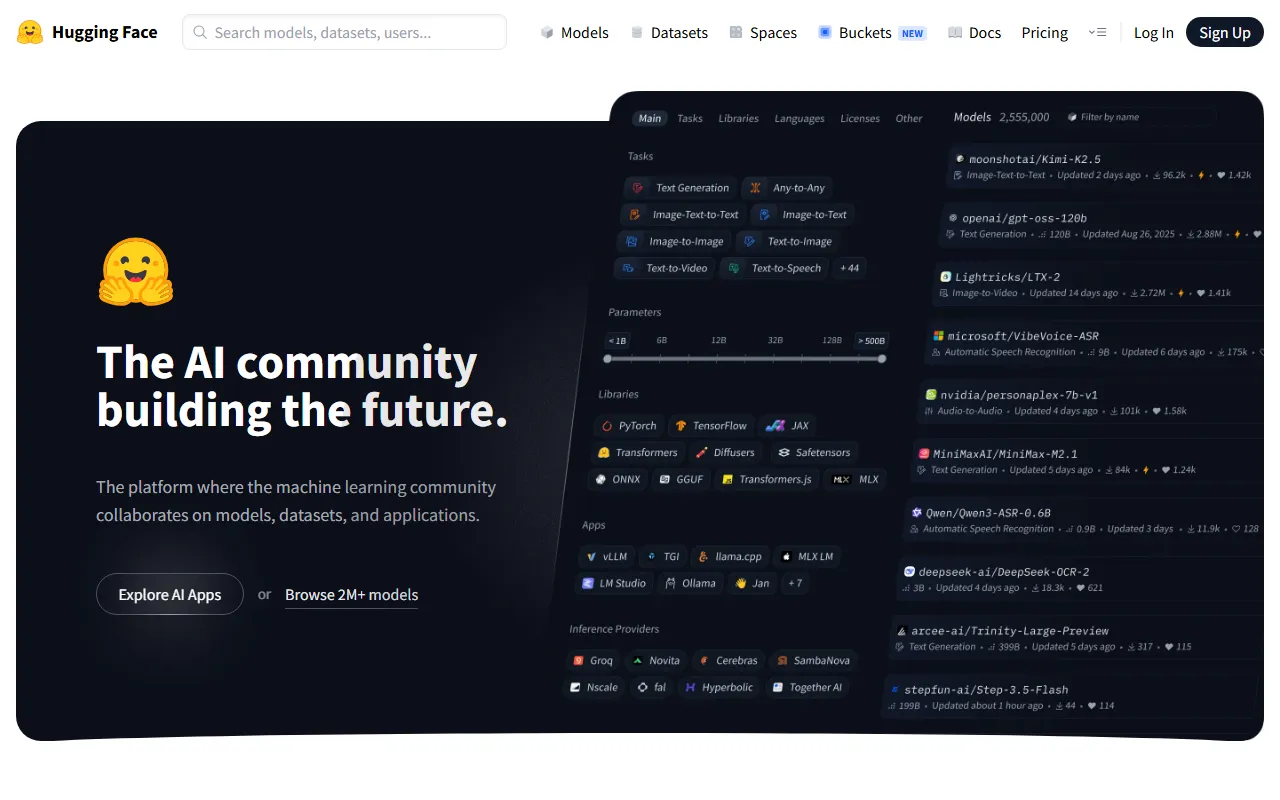

Hugging Face

AIコード補助AI・機械学習モデルの世界最大のオープンプラットフォーム。100万以上のモデル、データセット、デモアプリを公開・共有でき、AI開発のGitHubとも呼ばれる。

Hugging Faceとは?

Hugging Faceは、2016年にフランス・パリで設立されたAI企業が運営するオープンソースAIプラットフォームで、「AIのGitHub」とも称される世界最大のAI・機械学習コミュニティです。2026年現在、プラットフォーム上には100万以上の事前学習済みモデル、50万以上のデータセット、30万以上のデモアプリ(Spaces)がホストされており、Google、Meta、Microsoft、NVIDIA等のビッグテック企業から個人の研究者まで、世界中のAI開発者が利用しています。\n\nHugging Faceの中核をなすのが「Transformers」ライブラリです。自然言語処理(BERT、GPT系、Llama 3、Mistral等)、画像認識(Vision Transformer、CLIP等)、音声処理(Whisper、Bark等)、マルチモーダル(LLaVA等)のモデルを、統一されたAPIでわずか数行のPythonコードから利用できます。最新のオープンソースモデルがリリースされると、ほぼ同時にHugging Face上で公開されるため、AI研究の最前線にリアルタイムでアクセスできる点が他のプラットフォームにはない強みです。\n\nSpacesは、Hugging Face上でデモアプリを公開・共有できるプラットフォームです。GradioやStreamlitを使って構築されたインタラクティブなデモを、ブラウザから即座に試すことができます。研究者が論文と同時にデモをSpacesで公開するのが標準的なワークフローとなっており、最新のAI技術をコードを書かずに体験できます。例えば、Stable Diffusionの画像生成、Whisperの文字起こし、LLMのチャットなど、数千のデモが無料で利用可能です。\n\nInference APIとInference Endpointsは、AIモデルを本番環境にデプロイするためのサービスです。Inference APIはサーバーレスで、モデルを指定してAPIを呼び出すだけで推論結果を取得でき、プロトタイピングに最適です。より本格的な本番運用にはInference Endpointsが提供され、専用のGPUインスタンス上でモデルをホストし、オートスケーリング、カスタムコンテナ、VPCピアリング等のエンタープライズ機能を利用できます。\n\nAutoTrainは、ノーコードでカスタムモデルの学習を行える機能です。テキスト分類、感情分析、要約、画像分類、テーブルデータ予測など、一般的な機械学習タスクに対応しており、自分のデータセットをアップロードするだけでファインチューニング済みモデルが完成します。プログラミング不要でカスタムAIモデルを作れるため、データサイエンティスト以外のビジネスユーザーにも門戸が開かれています。\n\n実際の使用感として、Hugging Faceの最大の価値は「オープンソースAIのエコシステムの中心にいること」です。新しいモデルが発表されると、モデルのウェイト、学習コード、評価ベンチマーク、デモがHugging Face上で公開され、コミュニティが議論・改善を重ねます。この透明性とコラボレーションの文化は、クローズドソースのOpenAIやAnthropicとは対照的で、AIの民主化において重要な役割を果たしています。\n\n一方で、プラットフォーム上のモデルは品質にばらつきがあり、適切なモデルを選定するにはAI・MLの基礎知識が必要です。また、本格的な活用にはPythonの実装スキルが求められ、エンジニアリング以外のバックグラウンドの人にとってはハードルがあります。ただし、AutoTrainやSpacesの充実により、コードを書かずにAIを試せる入口は年々広がっています。\n\nライセンスについては、Hugging Face自体は商用利用可能ですが、個々のモデルにはそれぞれ異なるライセンス(Apache 2.0、MIT、Llama Community License、CreativeML OpenRAIL-M等)が設定されています。商用利用の際は、利用するモデルのライセンスを必ず確認する必要があります。企業向けには、プライベートモデルリポジトリ、アクセス制御、SSO、SLA付きサポートを含むEnterprise Hub($20/ユーザー/月)が提供されています。

料金プラン

主な機能・特徴

メリット・デメリット

メリット

- ●100万以上のAIモデルと50万以上のデータセットに無料でアクセス可能

- ●Transformersライブラリで最新のオープンソースモデルを数行のコードで利用

- ●Spacesで数千のAIデモをブラウザからコード不要で体験可能

- ●AutoTrainでノーコードのカスタムモデル学習が可能

- ●オープンソースAIエコシステムの中心で最新研究にリアルタイムアクセス

- ●Inference Endpointsで本番環境への簡単なモデルデプロイ

- ●Pro $9/月の手頃な価格でプライベートモデル・高速推論が利用可能

- ●活発なグローバルコミュニティと豊富なドキュメント

デメリット

- ●本格的な活用にはPythonのプログラミング知識が必須

- ●モデルの品質にばらつきがあり適切な選定にAI・ML知識が必要

- ●無料プランでのInference APIは速度・同時接続数に制限がある

- ●モデルごとにライセンスが異なり商用利用時の確認が面倒

- ●日本語ドキュメントやコミュニティは英語に比べて限定的

よくある質問(FAQ)

Q. Hugging Faceは無料で使えますか?

A. はい、公開モデル・データセットの利用、Transformersライブラリの使用、Spacesでのデモ公開は全て無料です。Inference APIの無料枠でモデルの推論も試せます。より高速な推論、プライベートリポジトリ、大容量ストレージが必要な場合はPro($9/月)プランを検討してください。

Q. プログラミングができなくても使えますか?

A. Spacesのデモアプリはブラウザ上で操作でき、AutoTrain機能ではGUIでカスタムモデル学習も可能なため、プログラミング不要で始められます。ただし、モデルのファインチューニングや本番デプロイなど本格的な活用にはPythonの知識が推奨されます。

Q. 商用利用は可能ですか?

A. Hugging Faceプラットフォーム自体は商用利用可能です。ただし、モデルごとにライセンスが異なります。Apache 2.0やMITライセンスのモデルは商用利用可能ですが、一部のモデルには制約があります(例:Llama Community Licenseは利用規約への同意が必要)。利用するモデルのライセンスページを必ず確認してください。

Q. OpenAIのAPIとどう使い分ければよいですか?

A. OpenAI APIはGPT-5等のクローズドソースモデルを簡便に利用したい場合に最適です。Hugging Faceはオープンソースモデルを自由にカスタマイズ・自社サーバーでホストしたい場合に適しています。データのプライバシー要件が厳しい場合やモデルのファインチューニングが必要な場合はHugging Faceが有利です。

Q. 日本語のAIモデルはありますか?

A. はい、日本語に対応した多数のモデルがホストされています。rinna社、サイバーエージェント、ELYZA等の日本企業が公開する日本語LLM、日本語BERT、日本語Whisperモデル等が利用可能です。「japanese」タグで検索すると数千のモデルが見つかります。

Q. Hugging FaceとGitHubの違いは?

A. GitHubはソースコード(テキストファイル)のバージョン管理に特化しています。Hugging FaceはAIモデル(数GB〜数百GBのバイナリファイル)とデータセットのホスティングに特化しており、Git LFSベースの効率的な大容量ファイル管理、モデルカード(ドキュメント)、Inference APIなどAI固有の機能を提供します。

関連するAI用語

関連ブログ記事

関連ツール

Google Colab

Googleが提供するクラウド上のPython実行環境。ブラウザだけでJupyter Notebookを実行でき、無料GPUも利用可能。機械学習・データサイエンスの定番ツール。

CodeRabbit

AIによる自動コードレビューツール。GitHub/GitLabのプルリクエストをAIが分析し、バグの検出、コード品質改善、セキュリティリスクの指摘を自動で実行。

Augment Code

大規模コードベースに特化したAIコーディングアシスタント。プロジェクト全体のコンテキストを深く理解し、的確なコード補完・生成・リファクタリングを提供。

Amazon Bedrock

AWSが提供するAI基盤サービス。Claude、Llama、Mistral等の主要AIモデルをAPIで利用でき、エンタープライズ向けのRAG、ファインチューニング、AIエージェント構築に対応。

Replit Agent

自然言語の指示だけでアプリケーションを構築・デプロイできるAIエージェント。コーディング不要でフルスタックWebアプリを数分で作成可能。

Bolt.new

StackBlitz開発のAI Webアプリビルダー。ブラウザ上で自然言語からフルスタックアプリを即座に生成・プレビュー・デプロイ。WebContainer技術で超高速。